- Edición Impresa

- 50 Años del Golpe

- El País

- Economía

- Sociedad

- Deportes

- El Mundo

- Opinión

- Contratapa

- Recordatorios

- Cultura

- Cash

- Radio 750

- Buenos Aires|12

- Rosario|12

- Salta|12

- Argentina|12

- Radar

- Radar Libros

- Soy

- Las12

- No

- Negrx

- Ciencia

- Universidad

- Psicología

- La Ventana

- Plástica

- Diálogos

- Opens in new window

- Suplementos Especiales

- Latinoamérica Piensa

- Malena

- Público

Dinamarca busca sancionar una ley para regular el contenido engañoso en redes

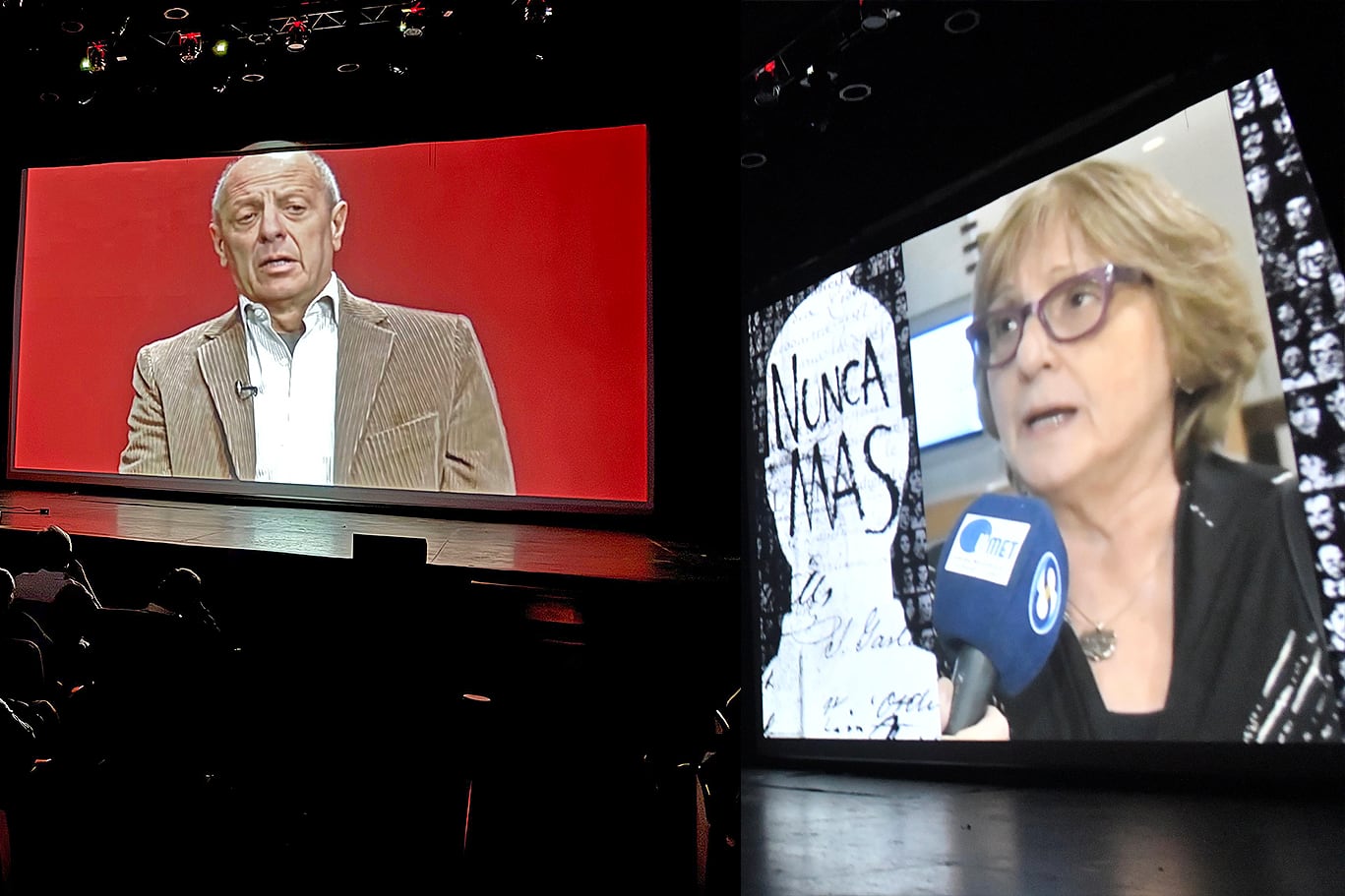

Un copyright a la voz, el rostro y el cuerpo de cada ciudadano

Gracias al avance de la inteligencia artificial, los videos y los audios falsos son cada vez más habituales. En Argentina, se utilizaron para hostigar a periodistas, o bien, para intentar influir en elecciones. La opinión de especialistas