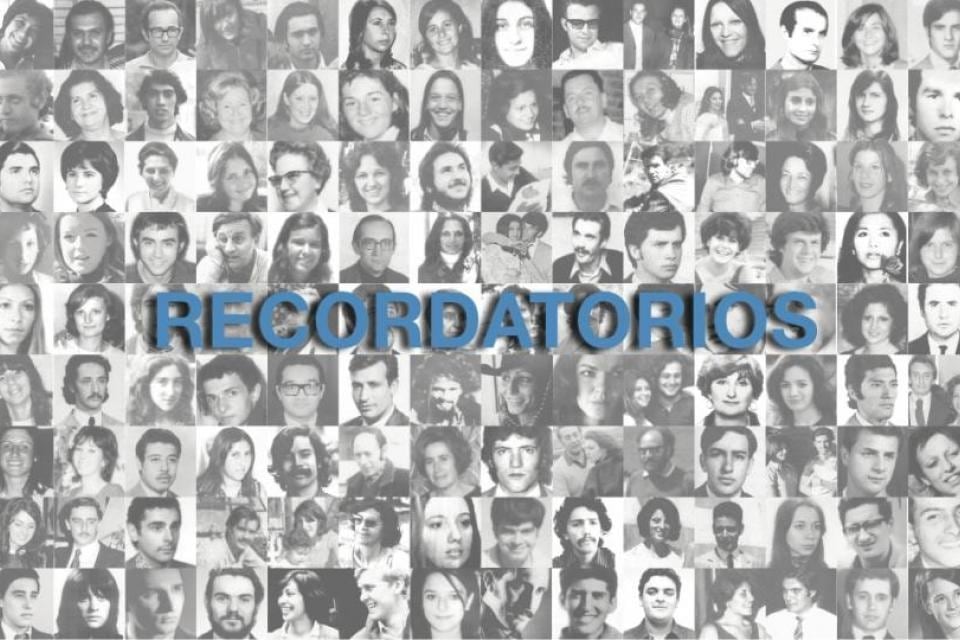

El lenguaje de las máquinas como reflejo del lenguaje de los humanos

Extrapolación de prejuicios

La revista Science aparece una vez por semana. Contiene artículos de múltiples disciplinas y permite tener una visión panorámica de lo que está ocurriendo en la frontera del conocimiento.